Дискретное распределение пуассона. Распределение Пуассона

Биномиальный закон распределения относится к случаям, когда была сделана выборка фиксированного объема. Распределение Пуассона относится к случаям, когда число случайных событий происходит на определенных длине, площади, объеме или времени, при этом определяющим параметром распределения является среднее число событийт , а не объем выборки п и вероятность успеха р. Например, количество несоответствий в выборке или количество несоответствий, приходящихся на единицу продукции.

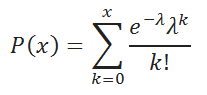

Распределение вероятностей для числа успехов х имеет при этом следующий вид:

Или можно сказать, что дискретная случайная величина X распределена по закону Пуассона, если ее возможные значения 0,1, 2, ...т, ...п, а вероятность появления таких значений определяется соотношением:

где m или λ- некоторая положительная величина, называемая параметром распределения Пуассона.

Закон Пуассона распространяется на «редко» происходящие события, при этом возможность очередной удачи (например, сбоя) сохраняется непрерывно, является постоянной и не зависит от числа предыдущих удач или неудач (когда речь идет о процессах, развивающихся во времени, это называют «независимостью от прошлого»). Классическим примером, когда применим закон Пуассона, является число телефонных вызовов на телефонной станции в течение заданного интервала времени. Другими примерами могут быть число чернильных клякс на странице, неаккуратно написанной рукописи, или число соринок, оказавшихся на кузове автомобиля во время его окраски. Закон распределения Пуассона измеряет число дефектов, а не число бракованных изделий.

Распределению Пуассона подчиняется количество случайных событий, которые появляются в фиксированные промежутки времени или в фиксированной области пространства, При λ<1 значение P(m) монотонно убывает с ростом m то, a при λ> 1 значениеP(m)с ростом т проходит через максимум вблизи /

Особенностью распределения Пуассона является равенство дисперсии математическому ожиданию. Параметры распределения Пуассона

M(x) = σ 2 = λ (15)

Эта особенность распределения Пуассона позволяет на практике утверждать, что экспериментально полученное распределение случайной величины подчинено распределению Пуассона, если выборочные значения математического ожидания и дисперсии примерно равны.

Закон редких событий применяется в машиностроении для выборочного контроля готовой продукции, когда по техническим условиям в принимаемой партии продукции допускается некоторый процент брака (обычно небольшой) q<<0.1.

Если вероятность q события А очень мала (q≤0,1), а число испытаний велико, то вероятность того, что событие А наступит m раз в n испытаниях, будет равна

где λ = М(х) = nq

Для вычисления распределения Пуассона можно пользоваться следующими рекуррентными соотношениями

Распределение Пуассона играет важную роль в статистических методах обеспечения качества, поскольку с его помощью можно аппроксимировать гипергеометрическое и биномиальное распределения.

Такая аппроксимация допустима, когда , при условии, что qn имеет конечный предел и q<0.1. Когда п →∞ , а р → 0, среднее п р = т = const.

При помощи закона редких событий можно вычислить вероятность того, что в выборке из n единиц будет содержаться: 0,1,2,3, и т.д. бракованных деталей, т.е. заданное m раз. Можно также вычислить вероятность появления в такой выборке m штук дефектных деталей и более. Эта вероятность на основании правила сложения вероятностей будет равна-:

Пример 1 . В партии имеются бракованные детали, доля которых составляет 0,1. Последовательно берут 10 деталей и обследуют, после чего их возвращают в партию, т.е. испытания носят независимый характер. Какова вероятность того, что при проверке 10 деталей попадется одна бракованная?

Решение Из условия задачи q=0,1; n=10; m=1.Очевидно, что р=1-q=0,9.

Полученный результат можно отнести и к тому случаю, когда извлекается подряд 10 деталей без возврата их обратно в партию. При достаточно большой партии, например, 1000 шт., вероятность извлечения деталей изменится ничтожно мало. Поэтому при таких условиях извлечение бракованной детали можно рассматривать как событие, не зависящее от результатов предшествующих испытаний.

Пример 2. В партии имеется 1% бракованных дета- лей. Какова вероятность того, что при взятии из партии выборки объемом 50 единиц продукции в ней будет находиться 0, 1, 2, 3 ,4дефектных деталей??

Решение. Здесь q=0.01, nq=50*0.01=0.5

Таким образом, для эффективного применения распределения Пуассона как аппроксимации биномиального необходимо, чтобы вероятность успеха р была существенно меньше q . a п р = т была порядка единицы (или нескольких единиц).

Таким образом, в статистических методах обеспечения качества

гипергеометрический закон применим для выборок любого объема п и любого уровня несоответствий q ,

биномиальный закон и закон Пуассона являются его частными случаями соответственно при условии, если n/N<0,1 и

Наиболее общим случаем различного рода вероятностных распределений является биномиальное распределение. Воспользуемся его универсальностью для определения наиболее часто встречающихся на практике частных видов распределений.

Биномиальное распределение

Пусть имеется некое событие A . Вероятность появления события A равна p , вероятность непоявления события A равна 1 p , иногда ее обозначают как q . Пусть n число испытаний, m частота появления события A в этих n испытаниях.

Известно, что суммарная вероятность всех возможных комбинаций исходов равна единице, то есть:

1 = p n + n · p n 1 · (1 p ) + C n n 2 · p n 2 · (1 p ) 2 + + C n m · p m · (1 p ) n m + + (1 p ) n .

|

p n вероятность того, что в n n раз; n · p n 1 · (1 p ) вероятность того, что в n n 1) раз и не произойдет 1 раз; C n n 2 · p n 2 · (1 p ) 2 вероятность того, что в n испытаниях событие A произойдет (n 2) раза и не произойдет 2 раза; P m = C n m · p m · (1 p ) n m вероятность того, что в n испытаниях событие A произойдет m раз и не произойдет (n m ) раз; (1 p ) n вероятность того, что в n испытаниях событие A не произойдет ни разу; число сочетаний из n по m . |

Математическое ожидание M биномиального распределения равно:

M = n · p ,

где n число испытаний, p вероятность появления события A .

Среднеквадратичное отклонение σ :

σ = sqrt(n · p · (1 p )) .

Пример 1 . Вычислить вероятность того, что событие, имеющее вероятность p = 0.5 , в n = 10 испытаниях произойдет m = 1 раз. Имеем: C 10 1 = 10 , и далее: P 1 = 10 · 0.5 1 · (1 0.5) 10 1 = 10 · 0.5 10 = 0.0098 . Как видим, вероятность наступления этого события достаточно мала. Объясняется это, во-первых, тем, что абсолютно не ясно, произойдет ли событие или нет, поскольку вероятность равна 0.5 и шансы здесь «50 на 50»; а во-вторых, требуется исчислить то, что событие произойдет именно один раз (не больше и не меньше) из десяти.

Пример 2 . Вычислить вероятность того, что событие, имеющее вероятность p = 0.5 , в n = 10 испытаниях произойдет m = 2 раза. Имеем: C 10 2 = 45 , и далее: P 2 = 45 · 0.5 2 · (1 0.5) 10 2 = 45 · 0.5 10 = 0.044 . Вероятность наступления этого события стала больше!

Пример 3 . Увеличим вероятность наступления самого события. Сделаем его более вероятным. Вычислить вероятность того, что событие, имеющее вероятность p = 0.8 , в n = 10 испытаниях произойдет m = 1 раз. Имеем: C 10 1 = 10 , и далее: P 1 = 10 · 0.8 1 · (1 0.8) 10 1 = 10 · 0.8 1 · 0.2 9 = 0.000004 . Вероятность стала меньше, чем в первом примере! Ответ, на первый взгляд, кажется странным, но поскольку событие имеет достаточно большую вероятность, вряд ли оно произойдет только один раз. Более вероятно, что оно произойдет большее, чем один, количество раз. Действительно, подсчитывая P 0 , P 1 , P 2 , P 3 , , P 10 (вероятность того, что событие в n = 10 испытаниях произойдет 0, 1, 2, 3, , 10 раз), мы увидим:

C

10 0 = 1

,

C

10 1 = 10

,

C

10 2 = 45

,

C

10 3 = 120

,

C

10 4 = 210

,

C

10 5 = 252

,

C

10 6 = 210

,

C

10 7 = 120

,

C

10 8 = 45

,

C

10 9 = 10

,

C

10 10 = 1

;

P

0 = 1 · 0.8 0 · (1 0.8) 10 0 = 1 · 1 · 0.2 10 = 0.0000

;

P

1 = 10 · 0.8 1 · (1 0.8) 10 1 = 10 · 0.8 1 · 0.2 9 = 0.0000

;

P

2 = 45 · 0.8 2 · (1 0.8) 10 2 = 45 · 0.8 2 · 0.2 8 = 0.0000

;

P

3 = 120 · 0.8 3 · (1 0.8) 10 3 = 120 · 0.8 3 · 0.2 7 = 0.0008

;

P

4 = 210 · 0.8 4 · (1 0.8) 10 4 = 210 · 0.8 4 · 0.2 6 = 0.0055

;

P

5 = 252 · 0.8 5 · (1 0.8) 10 5 = 252 · 0.8 5 · 0.2 5 = 0.0264

;

P

6 = 210 · 0.8 6 · (1 0.8) 10 6 = 210 · 0.8 6 · 0.2 4 = 0.0881

;

P

7 = 120 · 0.8 7 · (1 0.8) 10 7 = 120 · 0.8 7 · 0.2 3 = 0.2013

;

P

8 = 45 · 0.8 8 · (1 0.8) 10 8 = 45 · 0.8 8 · 0.2 2 = 0.3020

(самая большая вероятность!);

P

9 = 10 · 0.8 9 · (1 0.8) 10 9 = 10 · 0.8 9 · 0.2 1 = 0.2684

;

P

10 = 1 · 0.8 10 · (1 0.8) 10 10 = 1 · 0.8 10 · 0.2 0 = 0.1074

Разумеется, P 0 + P 1 + P 2 + P 3 + P 4 + P 5 + P 6 + P 7 + P 8 + P 9 + P 10 = 1 .

Нормальное распределение

Если изобразить величины P 0 , P 1 , P 2 , P 3 , , P 10 , которые мы подсчитали в примере 3, на графике, то окажется, что их распределение имеет вид, близкий к нормальному закону распределения (см. рис. 27.1 ) (см. лекцию 25. Моделирование нормально распределенных случайных величин).

вероятностей для различных m при p = 0.8, n = 10

Биномиальный закон переходит в нормальный, если вероятности появления и непоявления события A примерно одинаковы, то есть, условно можно записать: p ≈ (1 p ) . Для примера возьмем n = 10 и p = 0.5 (то есть p = 1 p = 0.5 ).

Содержательно к такой задаче мы придем, если, например, захотим теоретически посчитать, сколько будет мальчиков и сколько девочек из 10 родившихся в роддоме в один день детей. Точнее, считать будем не мальчиков и девочек, а вероятность, что родятся только мальчики, что родится 1 мальчик и 9 девочек, что родится 2 мальчика и 8 девочек и так далее. Примем для простоты, что вероятность рождения мальчика и девочки одинакова и равна 0.5 (но на самом деле, если честно, это не так, см. курс «Моделирование систем искусственного интеллекта»).

Ясно, что распределение будет симметричное, так как вероятность рождения 3 мальчиков и 7 девочек равна вероятности рождения 7 мальчиков и 3 девочек. Наибольшая вероятность рождения будет у 5 мальчиков и 5 девочек. Эта вероятность равна 0.25, кстати, не такая уж она и большая по абсолютной величине. Далее, вероятность того, что родится сразу 10 или 9 мальчиков намного меньше, чем вероятность того, что родится 5 ± 1 мальчик из 10 детей. Как раз биномиальное распределение нам поможет сделать этот расчет. Итак.

C

10 0 = 1

,

C

10 1 = 10

,

C

10 2 = 45

,

C

10 3 = 120

,

C

10 4 = 210

,

C

10 5 = 252

,

C

10 6 = 210

,

C

10 7 = 120

,

C

10 8 = 45

,

C

10 9 = 10

,

C

10 10 = 1

;

P

0 = 1 · 0.5 0 · (1 0.5) 10 0 = 1 · 1 · 0.5 10 = 0.000977

;

P

1 = 10 · 0.5 1 · (1 0.5) 10 1 = 10 · 0.5 10 = 0.009766

;

P

2 = 45 · 0.5 2 · (1 0.5) 10 2 = 45 · 0.5 10 = 0.043945

;

P

3 = 120 · 0.5 3 · (1 0.5) 10 3 = 120 · 0.5 10 = 0.117188

;

P

4 = 210 · 0.5 4 · (1 0.5) 10 4 = 210 · 0.5 10 = 0.205078

;

P

5 = 252 · 0.5 5 · (1 0.5) 10 5 = 252 · 0.5 10 = 0.246094

;

P

6 = 210 · 0.5 6 · (1 0.5) 10 6 = 210 · 0.5 10 = 0.205078

;

P

7 = 120 · 0.5 7 · (1 0.5) 10 7 = 120 · 0.5 10 = 0.117188

;

P

8 = 45 · 0.5 8 · (1 0.5) 10 8 = 45 · 0.5 10 = 0.043945

;

P

9 = 10 · 0.5 9 · (1 0.5) 10 9 = 10 · 0.5 10 = 0.009766

;

P

10 = 1 · 0.5 10 · (1 0.5) 10 10 = 1 · 0.5 10 = 0.000977

Разумеется, P 0 + P 1 + P 2 + P 3 + P 4 + P 5 + P 6 + P 7 + P 8 + P 9 + P 10 = 1 .

Отразим на графике величины P 0 , P 1 , P 2 , P 3 , , P 10 (см. рис. 27.2 ).

p = 0.5 и n = 10, приближающих его к нормальному закону

Итак, при условиях m ≈ n /2 и p ≈ 1 p или p ≈ 0.5 вместо биномиального распределения можно использовать нормальное. При больших значениях n график сдвигается вправо и становится все более пологим, так как математическое ожидание и дисперсия возрастают с увеличением n : M = n · p , D = n · p · (1 p ) .

Кстати, биномиальный закон стремится к нормальному и при увеличении n , что вполне естественно, согласно центральной предельной теореме (см. лекцию 34. Фиксация и обработка статистических результатов).

Теперь рассмотрим, как изменится биномиальный закон в случае, когда p ≠ q , то есть p > 0 . В этом случае применить гипотезу о нормальности распределения нельзя, и биномиальное распределение переходит в распределение Пуассона.

Распределение Пуассона

Распределение Пуассона это частный случай биномиального распределения (при n >> 0 и при p > 0 (редкие события)).

Из математики известна формула, позволяющая примерно подсчитать значение любого члена биномиального распределения:

где a = n · p параметр Пуассона (математическое ожидание), а дисперсия равна математическому ожиданию. Приведем математические выкладки, поясняющие этот переход. Биномиальный закон распределения

P m = C n m · p m · (1 p ) n m

может быть написан, если положить p = a /n , в виде

![]()

Так как p очень мало, то следует принимать во внимание только числа m , малые по сравнению с n . Произведение

весьма близко к единице. Это же относится к величине

Величина

очень близка к e a . Отсюда получаем формулу:

Пример . В ящике находится n = 100 деталей, как качественных, так и бракованных. Вероятность достать бракованное изделие составляет p = 0.01 . Допустим, что мы вынимаем изделие, определяем, бракованное оно или нет, и кладем его обратно. Поступая таким образом, получилось, что из 100 изделий, которые мы перебрали, два оказались бракованными. Какова вероятность этого?

По биномиальному распределению получаем:

По распределению Пуассона получаем:

Как видно, величины получились близкими, поэтому в случае редких событий вполне допустимо применять закон Пуассона, тем более что он требует меньших вычислительных затрат.

Покажем графически вид закона Пуассона. Возьмем для примера параметры p = 0.05 , n = 10 . Тогда:

C

10 0 = 1

,

C

10 1 = 10

,

C

10 2 = 45

,

C

10 3 = 120

,

C

10 4 = 210

,

C

10 5 = 252

,

C

10 6 = 210

,

C

10 7 = 120

,

C

10 8 = 45

,

C

10 9 = 10

,

C

10 10 = 1

;

P

0 = 1 · 0.05 0 · (1 0.05) 10 0 = 1 · 1 · 0.95 10 = 0.5987

;

P

1 = 10 · 0.05 1 · (1 0.05) 10 1 = 10 · 0.05 1 · 0.95 9 = 0.3151

;

P

2 = 45 · 0.05 2 · (1 0.05) 10 2 = 45 · 0.05 2 · 0.95 8 = 0.0746

;

P

3 = 120 · 0.05 3 · (1 0.05) 10 3 = 120 · 0.05 3 · 0.95 7 = 0.0105

;

P

4 = 210 · 0.05 4 · (1 0.05) 10 4 = 210 · 0.05 4 · 0.95 6 = 0.00096

;

P

5 = 252 · 0.05 5 · (1 0.05) 10 5 = 252 · 0.05 5 · 0.95 5 = 0.00006

;

P

6 = 210 · 0.05 6 · (1 0.05) 10 6 = 210 · 0.05 6 · 0.95 4 = 0.0000

;

P

7 = 120 · 0.05 7 · (1 0.05) 10 7 = 120 · 0.05 7 · 0.95 3 = 0.0000

;

P

8 = 45 · 0.05 8 · (1 0.05) 10 8 = 45 · 0.05 8 · 0.95 2 = 0.0000

;

P

9 = 10 · 0.05 9 · (1 0.05) 10 9 = 10 · 0.05 9 · 0.95 1 = 0.0000

;

P

10 = 1 · 0.05 10 · (1 0.05) 10 10 = 1 · 0.05 10 · 0.95 0 = 0.0000

Разумеется, P 0 + P 1 + P 2 + P 3 + P 4 + P 5 + P 6 + P 7 + P 8 + P 9 + P 10 = 1 .

При n > ∞ распределение Пуассона переходит в нормальный закон, согласно центральной предельной теореме (см.

Рассмотрим распределение Пуассона, вычислим его математическое ожидание, дисперсию, моду. С помощью функции MS EXCEL ПУАССОН.РАСП() построим графики функции распределения и плотности вероятности. Произведем оценку параметра распределения, его математического ожидания и стандартного отклонения.

Сначала дадим сухое формальное определение распределения, затем приведем примеры ситуаций, когда распределение Пуассона (англ. Poisson distribution ) является адекватной моделью для описания случайной величины.

Если случайные события происходят в заданный период времени (или в определенном объеме вещества) со средней частотой λ(лямбда ), то число событий x , произошедших за этот период времени, будет иметь распределение Пуассона .

Применение распределения Пуассона

Примеры, когда Распределение Пуассона является адекватной моделью:

- число вызовов, поступивших на телефонную станцию за определенный период времени;

- число частиц, подвергнувшихся радиоактивному распаду за определенный период времени;

- число дефектов в куске ткани фиксированной длины.

Распределение Пуассона является адекватной моделью, если выполняются следующие условия:

- события происходят независимо друг от друга, т.е. вероятность последующего события не зависит от предыдущего;

- средняя частота событий постоянна. Как следствие, вероятность события пропорциональна длине интервала наблюдения;

- два события не могут произойти одновременно;

- число событий должно принимать значения 0; 1; 2…

Примечание : Хорошей подсказкой, что наблюдаемая случайная величина имеет распределение Пуассона, является тот факт, что приблизительно равно (см. ниже).

Ниже представлены примеры ситуаций, когда Распределение Пуассона не может быть применено:

- число студентов, которые выходят из университета в течение часа (т.к. средний поток студентов не постоянен: во время занятий студентов мало, а в перерыве между занятиями число студентов резко возрастает);

- число землетрясений амплитудой 5 баллов в год в Калифорнии (т.к. одно землетрясение может вызвать повторные толчки сходной амплитуды – события не независимы);

- число дней, которые пациенты проводят в отделении интенсивной терапии (т.к. число дней, которое пациенты проводят в отделении интенсивной терапии всегда больше 0).

Примечание : Распределение Пуассона является приближением более точных дискретных распределений: и .

Примечание : О взаимосвязи распределения Пуассона и Биномиального распределения можно прочитать в статье . О взаимосвязи распределения Пуассона и Экспоненциального распределения можно прочитать в статье про .

Распределение Пуассона в MS EXCEL

В MS EXCEL, начиная с версии 2010, для Распределения Пуассона имеется функция ПУАССОН.РАСП() , английское название - POISSON.DIST(), которая позволяет вычислить не только вероятность того, что за заданный период времени произойдет х событий (функцию плотности вероятности p(x), см. формулу выше), но и (вероятность того, что за заданный период времени произойдет не меньше x событий).

До MS EXCEL 2010 в EXCEL была функция ПУАССОН() , которая также позволяет вычислить функцию распределения и плотность вероятности p(x). ПУАССОН() оставлена в MS EXCEL 2010 для совместимости.

В файле примера приведены графики плотности распределения вероятности и интегральной функции распределения .

Распределение Пуассона имеет скошенную форму (длинный хвост справа у функции вероятности), но при увеличении параметра λ становится все более симметричным.

Примечание : Среднее и дисперсия (квадрат ) равны параметру распределения Пуассона – λ (см. файл примера лист Пример ).

Задача

Типичным применением Распределения Пуассона в контроле качества является модель количества дефектов, которые могут появиться в приборе или устройстве.

Например, при среднем количестве дефектов в микросхеме λ (лямбда) равном 4, вероятность, что случайно выбранная микросхема будет иметь 2 или меньше дефектов, равна: =ПУАССОН.РАСП(2;4;ИСТИНА)=0,2381

Третий параметр в функции установлен = ИСТИНА, поэтому функция вернет интегральную функцию распределения , то есть вероятность того, что число случайных событий окажется в диапазоне от 0 до 4 включительно.

Вычисления в этом случае производятся по формуле:

Вероятность того, что случайно выбранная микросхема будет иметь ровно 2 дефекта, равна: =ПУАССОН.РАСП(2;4;ЛОЖЬ)=0,1465

Третий параметр в функции установлен = ЛОЖЬ, поэтому функция вернет плотность вероятности.

Вероятность того, что случайно выбранная микросхема будет иметь больше 2-х дефектов, равна: =1-ПУАССОН.РАСП(2;4;ИСТИНА) =0,8535

Примечание : Если x не является целым числом, то при вычислении формулы . Формулы =ПУАССОН.РАСП(2 ; 4; ЛОЖЬ) и =ПУАССОН.РАСП(2,9 ; 4; ЛОЖЬ) вернут одинаковый результат.

Генерация случайных чисел и оценка λ

При значениях λ>15 , Распределение Пуассона хорошо аппроксимируется Нормальным распределением со следующими параметрами: μ=λ , σ 2 =λ .

Подробнее о связи этих распределений, можно прочитать в статье . Там же приведены примеры аппроксимации, и пояснены условия, когда она возможна и с какой точностью.

СОВЕТ : О других распределениях MS EXCEL можно прочитать в статье .

Введение

Подчиняются ли каким-либо законам явления, носящие случайный характер? Да, но эти законы отличаются от привычных нам физических законов. Значения СВ невозможно предугадать даже при известных условиях эксперимента, мы можем лишь указать вероятности того, что СВ примет то или иное значение. Зато зная распределение вероятностей СВ, мы можем делать выводы о событиях, в которых участвуют эти случайные величины. Правда, эти выводы будут также носить вероятностный характер.

Пусть некоторая СВ является дискретной, т.е. может принимать лишь фиксированные значения Xi. В этом случае ряд значений вероятностей P(Xi) для всех (i=1…n) допустимых значений этой величины называют её законом распределения.

Закон распределения СВ - это отношение, устанавливающее связь между возможными значениями СВ и вероятностями, с которыми принимаются эти значения. Закон распределения полностью характеризует СВ.

При построении математической модели для проверки статистической гипотезы необходимо ввести математическое предположение о законе распределения СВ (параметрический путь построения модели).

Непараметрический подход к описанию математической модели (СВ не имеет параметрического закона распределения) менее точен, но имеет более широкую область применения.

Точно также, как и для вероятности случайного события, для закона распределения СВ есть только два пути его отыскания. Либо мы строим схему случайного события и находим аналитическое выражение (формулу) вычисления вероятности (возможно, кто–то уже сделал или сделает это за нас!), либо придется использовать эксперимент и по частотам наблюдений делать какие–то предположения (выдвигать гипотезы) о законе распределения.

Конечно же, для каждого из "классических" распределений уже давно эта работа проделана – широко известными и очень часто используемыми в прикладной статистике являются биномиальное и полиномиальное распределения, геометрическое и гипергеометрическое, распределение Паскаля и Пуассона и многие другие.

Для почти всех классических распределений немедленно строились и публиковались специальные статистические таблицы, уточняемые по мере увеличения точности расчетов. Без использования многих томов этих таблиц, без обучения правилам пользования ими последние два столетия практическое использование статистики было невозможно.

Сегодня положение изменилось – нет нужды хранить данные расчетов по формулам (как бы последние не были сложны!), время на использование закона распределения для практики сведено к минутам, а то и секундам. Уже сейчас существует достаточное количество разнообразных пакетов прикладных компьютерных программ для этих целей.

Среди всех вероятностных распределений есть такие, которые используются на практике особенно часто. Эти распределения детально изучены и свойства их хорошо известны. Многие из этих распределений лежат в основе целых областей знаний – таких, как теория массового обслуживания, теория надежности, контроль качества, теория игр и т.п

Среди них нельзя не обратить внимание на труды Пуассона (1781-1840), доказавшего более общую, чем у Якова Бернулли, форму закона больших чисел, а также впервые применившего теорию вероятностей к задачам стрельбы. С именем Пуассона связан один из законов распределения, играющий большую роль в теории вероятностей и ее приложениях.

Именно этому закону распределения и посвящена данная курсовая работа. Речь пойдет непосредственно о законе, о его математических характеристиках, особых свойствах, связи с биномиальным распределением. Несколько слов будет сказано по поводу практического применения и приведено несколько примеров из практики.

Цель нашего реферата – выяснить сущность теорем распределения Бернулли и Пуассона.

Задача – изучить и проанализировать литературу по теме реферата.

1. Биномиальное распределение (распределение Бернулли)

Биномиальное распределение (распределение Бернулли) - распределение вероятностей числа появлений некоторого события при повторных независимых испытаниях, если вероятность появления этого события в каждом испытании равна p (0

Говорят, что СВ Х распределена по закону Бернулли с параметром p, если она принимает значения 0 и 1 с вероятностями pX(x)ºP{X=x} = pxq1-x; p+q=1; x=0,1.

Биноминальное распределение возникает в тех случаях, когда ставится вопрос: сколько раз происходит некоторое событие в серии из определенного числа независимых наблюдений (опытов), выполняемых в одинаковых условиях.

Для удобства и наглядности будем полагать, что нам известна величина p – вероятность того, что вошедший в магазин посетитель окажется покупателем и (1– p) = q – вероятность того, что вошедший в магазин посетитель не окажется покупателем.

Если X – число покупателей из общего числа n посетителей, то вероятность того, что среди n посетителей оказалось k покупателей равна

P(X= k) = , где k=0,1,…n 1)

Формулу (1) называют формулой Бернулли. При большом числе испытаний биномиальное распределение стремиться к нормальному.

Испытание Бернулли – это вероятностный эксперимент с двумя исходами, которые, как правило, называют «успехом» (его принято обозначать символом 1) и «неудачей» (соответственно, обозначается 0). Вероятность успеха принято обозначать буквой p, неудачи – буквой q; конечно, q=1-p. Величину p называют параметром испытания Бернулли.

Биномиальная, геометрическая, паскалева и отрицательная биномиальная случайные величины получаются из последовательности независимых испытаний Бернулли, если эту последовательность оборвать тем или иным способом, например, после n-го испытания или x-го успеха. Принято использовать следующую терминологию:

– параметр испытания Бернулли (вероятность успеха в отдельном испытании);

– число испытаний;

– число успехов;

– число неудач.

Биномиальная случайная величина (m|n,p) – число m успехов в n испытаниях.

Геометрическая случайная величина G(m|p)– число m испытаний до первого успеха (включая первый успех).

Паскалева случайная величина C(m|x,p)– число m испытаний до x-го успеха (не включая, конечно, сам x-й успех).

Отрицательная биномиальная случайная величина Y(m|x,p) – число m неудач до x-го успеха (не включая x-й успех).

Замечание: иногда отрицательное биномиальное распределение называют паскалевым и наоборот.

Распределение Пуассона

2.1. Определение закона Пуассона

Во многих задачах практики приходится иметь дело со случайными величинами, распределенными по своеобразному закону, который носит название закона Пуассона.

Рассмотрим прерывную случайную величину Х, которая может принимать только целые, неотрицательные значения: 0, 1, 2, … , m, … ; причем последовательность этих значений теоретически не ограничена. Говорят, что случайная величина Х распределена по закону Пуассона, если вероятность того, что она примет определенное значение m, выражается формулой:

![]()

где а - некоторая положительная величина, называемая параметром закона Пуассона.

Ряд распределения случайной величины Х, распределенной по закону Пуассона, выглядит следующим образом:

| хm | … | m | … | |||

| Pm | e-a | … | … |

2.2.Основные характеристики распределения Пуассона

Для начала убедимся, что последовательность вероятностей, может представлять собой ряд распределения, т.е. что сумма всех вероятностей Рm равна единице.

![]()

Используем разложение функции ех в ряд Маклорена:

![]()

Известно, что этот ряд сходится при любом значении х, поэтому, взяв х=а, получим

![]()

следовательно

![]()

Определим основные характеристики - математическое ожидание и дисперсию - случайной величины Х, распределенной по закону Пуассона. Математическим ожиданием дискретной случайной величины называют сумму произведений всех ее возможных значений на их вероятности. По определению, когда дискретная случайная величина принимает счетное множество значений:

![]()

Первый член суммы (соответствующий m=0) равен нулю, следовательно, суммирование можно начинать с m=1:

Таким образом, параметр а представляет собой не что иное, как математическое ожидание случайной величины Х.

Дисперсией случайной величины Х называют математической ожидание квадрата отклонения случайной величины от ее математического ожидания:

Однако, удобнее ее вычислять по формуле:

Поэтому найдем сначала второй начальный момент величины Х:

По ранее доказанному

![]()

кроме того,

![]()

2.3.Дополнительные характеристики распределения Пуассона

I. Начальным моментом порядка k случайной величины Х называют математическое ожидание величины Хk:

В частности, начальный момент первого порядка равен математическому ожиданию:

II. Центральным моментом порядка k случайной величины Х называют математическое ожидание величины k:

В частности, центральный момент 1-ого порядка равен 0:

μ1=М=0,

центральный момент 2-ого порядка равен дисперсии:

μ2=M2=a.

III. Для случайной величины Х, распределенной по закону Пуассона, найдем вероятность того, что она примет значение не меньшее заданного k. Эту вероятность обозначим Rk:

![]()

Очевидно, вероятность Rk может быть вычислена как сумма

![]()

Однако, значительно проще определить ее из вероятности противоположного события:

![]()

В частности, вероятность того, что величина Х примет положительное значение, выражается формулой

![]()

Как уже говорилось, многие задачи практики приводят к распределению Пуассона. Рассмотрим одну из типичных задач такого рода.

|

Пусть на оси абсцисс Ох случайным образом распределяются точки (рис.2). Допустим, что случайное распределение точек удовлетворяет следующим условиям:

1) Вероятность попадания того или иного числа точек на отрезок l зависит только от длины этого отрезка, но не зависит от его положения на оси абсцисс. Иными словами, точки распределены на оси абсцисс с одинаковой средней плотностью. Обозначим эту плотность, т.е. математическое ожидание числа точек, приходящихся на единицу длины, через λ.

2) Точки распределяются на оси абсцисс независимо друг от друга, т.е. вероятность попадания того или иного числа точек на заданный отрезок не зависит от того, сколько их попало на любой другой отрезок, не перекрывающийся с ним.

3) Вероятность попадания на малый участок Δх двух или более точек пренебрежимо мала по сравнению с вероятностью попадания одной точки (это условие означает практическую невозможность совпадения двух или более точек).

Выделим на оси абсцисс определенный отрезок длины l и рассмотрим дискретную случайную величину Х - число точек, попадающих на этот отрезок. Возможные значения величины будут 0,1,2,…,m,… Так как точки попадают на отрезок независимо друг от друга, то теоретически не исключено, что их там окажется сколь угодно много, т.е. данный ряд продолжается неограниченно.

Докажем, что случайная величина Х распределена по закону Пуассона. Для этого надо подсчитать вероятность Рm того, что на отрезок попадет ровно m точек.

Сначала решим более простую задачу. Рассмотрим на оси Ох малый участок Δх и вычислим вероятность того, что на этот участок попадет хотя бы одна точка. Будем рассуждать следующим образом. Математическое ожидание числа точек, попадающих на этот участок, очевидно, равно λ·Δх (т.к. на единицу длины попадает в среднем λ точек). Согласно условию 3 для малого отрезка Δх можно пренебречь возможностью попадания на него двух или больше точек. Поэтому математическое ожидание λ·Δх числа точек, попадающих на участок Δх, будет приближенно равно вероятности попадания на него одной точки (или, что в данных условиях равнозначно, хотя бы одной).

Таким образом, с точностью до бесконечно малых высшего порядка, при Δх→0 можно считать вероятность того, что на участок Δх попадет одна (хотя бы одна) точка, равной λ·Δх, а вероятность того, что не попадет ни одной, равной 1-c·Δх.

Воспользуемся этим для вычисления вероятности Pm попадания на отрезок l ровно m точек. Разделим отрезок l на n равных частей длиной Условимся называть элементарный отрезок Δх "пустым", если в него не попало ни одной точки, и "занятым", если в него попала хотя бы одна. Согласно вышедоказанному вероятность того, что отрезок Δх окажется "занятым", приближенно равна λ·Δх= ; вероятность того, что он окажется "пустым", равна 1- . Так как, согласно условию 2, попадания точек в неперекрывающиеся отрезки независимы, то наши n отрезков можно рассмотреть как n независимых "опытов", в каждом из которых отрезок может быть "занят" с вероятностью p= . Найдем вероятность того, что среди n отрезков будет ровно m "занятых". По теореме о повторных независимых испытаниях эта вероятность равна

![]() ,

,

или обозначим λl=a:

![]() .

.

При достаточно большом n эта вероятность приближенно равна вероятности попадания на отрезок l ровно m точек, т.к. попадание двух или больше точек на отрезок Δх имеет пренебрежимо малую вероятность. Для того, чтобы найти точное значение Рm, нужно перейти к пределу при n→∞:

Учитывая, что

,

,

получаем, что искомая вероятность выражается формулой

где а=λl, т.е. величина Х распределена по закону Пуассона с параметром а=λl.

Надо отметить, что величина а по смыслу представляет собой среднее число точек, приходящееся на отрезок l. Величина R1 (вероятность того, что величина Х примет положительное значение) в данном случае выражает вероятность того, что на отрезок l попадет хотя бы одна точка: R1=1-e-a.

Таким образом, мы убедились, что распределение Пуассона возникает там, где какие-то точки (или другие элементы) занимают случайное положение независимо друг от друга, и подсчитывается количество этих точек, попавших в какую-то область. В нашем случае такой областью был отрезок l на оси абсцисс. Однако этот вывод легко можно распространить и на случай распределения точек на плоскости (случайное плоское поле точек) и в пространстве (случайное пространственное поле точек). Нетрудно доказать, что если соблюдены условия:

1) точки распределены в поле статистически равномерно со средней плотностью λ;

2) точки попадают в неперекрывающиеся области независимым образом;

3) точки появляются поодиночке, а не парами, тройками и т.д.,

то число точек Х, попавших в любую область D (плоскую или пространственную), распределяется по закону Пуассона:

![]() ,

,

где а - среднее число точек, попадающих в область D.

Для плоского случая а=SD λ, где SD - площадь области D,

для пространственного а= VD λ, где VD - объем области D.

Для пуассоновского распределения числа точек, попадающих в отрезок или область, условие постоянной плотности (λ=const) несущественно. Если выполнены два других условия, то закон Пуассона все равно имеет место, только параметр а в нем приобретает другое выражение: он получается не простым умножением плотности λ на длину, площадь или объем, а интегрированием переменной плотности по отрезку, площади или объему.

Распределение Пуассона играет важную роль в ряде вопросов физики, теории связи, теории надежности, теории массового обслуживания и т.д. Всюду, где в течение определенного времени может происходить случайное число каких-то событий (радиоактивных распадов, телефонных вызовов, отказов оборудования, несчастный случаях и т.п.).

Рассмотрим наиболее типичную ситуацию, в которой возникает распределение Пуассона. Пусть некоторые события (покупки в магазине) могут происходить в случайные моменты времени. Определим число появлений таких событий в промежутке времени от 0 до Т.

Случайное число событий, происшедших за время от 0 до Т, распределено по закону Пуассона с параметром l=аТ, где а>0 – параметр задачи, отражающий среднюю частоту событий. Вероятность k покупок в течение большого интервала времени, (например, – дня) составит

Заключение

В заключение хочется отметить то, что распределение Пуассона является достаточно распространенным и важным распределением, имеющим применение как в теории вероятностей и ее приложениях, так и в математической статистике.

Многие задачи практики сводятся в конечном счете к распределению Пуассона. Его особое свойство, заключающееся в равенстве математического ожидания и дисперсии, часто применяют на практике для решения вопроса, распределена случайная величина по закону Пуассона или нет.

Также важен тот факт, что закон Пуассона позволяет находить вероятности события в повторных независимых испытаниях при большом количестве повторов опыта и малой единичной вероятности.

Однако распределение Бернулли применяется в практике экономических расчетов и в частности при анализе устойчивости исключительно редко. Это связано как с вычислительными сложностями, так и с тем, что распределение Бернулли – для дискретных величин, и с тем, что условия классической схемы (независимость, счетное число испытаний, неизменность условий, влияющих на возможность наступления события) не всегда выполняются в практических ситуациях. Дальнейшие исследования в области анализа схемы Бернулли, проводимые в XVIII-XIX вв. Лапласом, Муавром, Пуассоном и другими были направлены на создание возможности использования схемы Бернулли в случае большого, стремящегося к бесконечности количества испытаний.

Литература

1. Вентцель Е.С. Теория вероятностей. - М, "Высшая школа" 1998

2. Гмурман В.Е. Руководство к решению задач по теории вероятностей и математической статистике. - М, "Высшая школа" 1998

3. Сборник задач по математике для втузов. Под ред. Ефимова А.В. - М, Наука 1990

При рассмотрении маловероятных событий, имеющих место в большой серии независимых испытаний некоторое (конечное) число раз, вероятности появления этих событий подчиняются закону Пуассона или закону редких событий , где λ равна среднему числу появления событий в одинаковых независимых испытаниях, т.е. λ = n × p, где p – вероятность события при одном испытании, e = 2,71828 , m -частота данного события, математическое ожидание M[X] равно λ.

Ряд распределения закона Пуассона имеет вид:

Числовые характеристики случайной величины Х

Математическое ожидание распределения ПуассонаM[X] = λ

Дисперсия распределения Пуассона

D[X] = λ

Закон Пуассона

можно применять для совокупностей, достаточно больших по объему (n > 100) и имеющих достаточно малую долю единиц, обладающих данным признаком (p < 0,1).

При этом распределение Пуассона можно применить, когда на только не известно значение n – общего числа возможных результатов, но и когда не известно конечное число, которое n может представлять. Там, где есть среднее число случаев наступления события, вероятность наступления события описывается членами разложения:

.

Поэтому соответствующие вероятности равны:

Поэтому, если среднее число землетрясений равно одному в месяц, то m=1 и вероятность случаев в месяц будет следующей, рассчитанной по приблизительному значению e - m =0,3679:

Пример . В результате проверки 1000 партий одинаковых изделий получено следующее распределение количества бракованных изделий в партии:

Определим среднее число бракованных изделий в партии:

.

Находим теоретические частоты закона Пуассона:

Эмпирически и найденное теоретическое распределение Пуассона:

| 604 | 306 | 77 | 12 | 1 |

| 606 | 303 | 76 | 13 | 2 |

Сопоставление свидетельствует о соответствии эмпирического распределения распределению Пуассона.

Пример №2 . Отдел технического контроля проверил n партий однотипных изделий и установил, что число Х нестандартных изделий в одной партии имеет эмпирическое распределение, приведенное в таблице, в одной строке которой указано количество x i нестандартных изделий в одной партии, а в другой строке – количество n i партий, содержащих x i нестандартных изделий. Требуется при уровне значимости α=0.05 проверить гипотезу о том, что случайная величина Х (число нестандартных изделий в одной партии) распределена по закону Пуассона .

| x i | 0 | 1 | 2 | 3 | 4 | 5 |

| n i | 370 | 360 | 190 | 63 | 14 | 3 |

Проверим гипотезу о том, что Х распределено по закону Пуассона с помощью сервиса проверка статистических гипотез .

где p i - вероятность попадания в i-й интервал случайной величины, распределенной по гипотетическому закону; λ = x ср.

i = 0: p 0 = 0.3679, np 0 = 367.88

i = 1: p 1 = 0.3679, np 1 = 367.88

i = 2: p 2 = 0.1839, np 2 = 183.94

i = 3: p 3 = 0.0613, np 3 = 61.31

i = 4: p 4 = 0.0153, np 4 = 15.33

i = 5: p 5 = 0.0031, np 5 = 3.07

i = 6: 17=14 + 3

i = 6: 18.39=15.33 + 3.07

| i | Наблюдаемая частота n i | p i | Ожидаемая частота np i | |

| 0 | 370 | 0.37 | 367.88 | 0.0122 |

| 1 | 360 | 0.37 | 367.88 | 0.17 |

| 2 | 190 | 0.18 | 183.94 | 0.2 |

| 3 | 63 | 0.0613 | 61.31 | 0.0464 |

| 4 | 17 | 0.0153 | 18.39 | 0.11 |

| 1000 | 0.53 |

Определим границу критической области. Так как статистика Пирсона измеряет разницу между эмпирическим и теоретическим распределениями, то чем больше ее наблюдаемое значение K набл, тем сильнее довод против основной гипотезы.

Поэтому критическая область для этой статистики всегда правосторонняя: }